Як дипфейки використовують в пропаганді? — Вадим Міський у проєкті «Відсіч дезінформації»

У випуску — як технології штучного інтелекту використовуються в пропаганді та як розпізнати фейковий контент. А також проведемо експеримент зі створення дипфейку.

Вадим Міський, програмний директор ГО «Детектор медіа»

Що таке дипфейк, чим він відрізняється від звичайного фейку, і чому ця тема зараз настільки важлива?

Дипфейк — це вид фейку, який створюється за допомогою штучного інтелекту (ШІ) та технологій глибинного навчання. Від звичайних фейків, які можуть включати неправдиві новини, маніпулятивні заголовки або фотомонтажі, дипфейки відрізняються високим рівнем деталізації та реалістичності. Вони дозволяють підроблювати відео і аудіо таким чином, що пересічному користувачеві інтернету може бути важко відрізнити їх від справжніх.

Технологія глибинного навчання, на якій базуються дипфейки, використовує величезні масиви даних для навчання алгоритмів, що імітують людські обличчя, міміку, рухи та голос. Вони здатні створювати переконливі відео або аудіо, у яких відомі особи говорять або роблять речі, яких насправді ніколи не робили. Це робить дипфейки надзвичайно небезпечними інструментами дезінформації, маніпуляції та пропаганди.

Один із найвідоміших прикладів використання дипфейку — на початку війни в Україні у 2022 році, коли було розповсюджене відео, на якому президент України Володимир Зеленський нібито «закликає українських військових скласти зброю». Це відео одразу викликало підозри у фахівців та громадськості, адже його якість залишала бажати кращого — обличчя Зеленського виглядало неприродно, а його рухи не відповідали реальним рухам. Звук також був синтетичним, це свідчило про те, що відео було підроблене. Це був перший досвід масового використання дипфейку в контексті війни, і він мав на меті деморалізувати українських військових і громадян.

Як розвивалися технології дипфейків з того часу, і як вони використовуються зараз?

З часом технології дипфейків удосконалювалися. З'явилися нові приклади, де дипфейки стали ще більш реалістичними. Російські пропагандисти почали використовувати ці технології для створення більш якісних підробок. Наприклад, був випадок, коли створили дипфейк з Валерієм Залужним, де він нібито закликав до збройного повстання. Це відео вже було набагато складніше розпізнати як фейк. В ньому були набагато реалістичніші рухи обличчя, голос був схожий на справжній, а загальна якість зображення та звуку була кращою.

Які ознаки, за якими можна визначити, що відео є дипфейком, навіть якщо воно виглядає дуже реалістично?

Попри те, що сучасні дипфейки стають дедалі технологічними, їх все ще можна розпізнати за певними ознаками. Наприклад, у випадку з дипфейк-відео з Олексієм Даніловим, де його нібито увімкнули в прямий ефір телемарафону — уважний глядач може помітити аномалії у вимові та певні рухи губ, які не відповідають вимовленим словам. Однією з таких аномалій була неправильний наголос у слові «веселощі». Хоча сучасні технології здатні точно відтворювати міміку і навіть інтонації голосу, дрібні помилки, наприклад, неправильно вимовлене слово або неузгодженість між рухом губ і звуком, все ще можуть видавати фейк.

Для чого можуть використовуватися такі фейки? Які їхні потенційні загрози?

Існує багато причин, чому люди або організації можуть створювати дипфейки. Коли ця технологія тільки з'явилася, вона використовувалася переважно у розважальних цілях — для створення кумедних відео або для фанатських відеороликів. Проте з часом спектр використання дипфейків значно розширився. Вони почали застосовуватися у політичній боротьбі, для дискредитації політичних супротивників, створення підроблених новин, а також у шахрайських схемах. Один із найтривожніших аспектів використання дипфейків — створення підроблених порно-відео або інших компрометуючих матеріалів, що може серйозно зашкодити репутації конкретних людей.

Наскільки великою є загроза репутаційних втрат або шахрайства через використання дипфейків?

Дипфейки можуть використовуватися для шахрайства, наприклад, у випадках, коли за допомогою підробленого голосу обманюють людей або організації. Шахраї можуть створювати дипфейки голосів керівників компаній, аби отримати доступ до фінансових ресурсів або важливої інформації. Такі шахрайські схеми можуть призвести до величезних фінансових втрат і серйозних репутаційних наслідків.

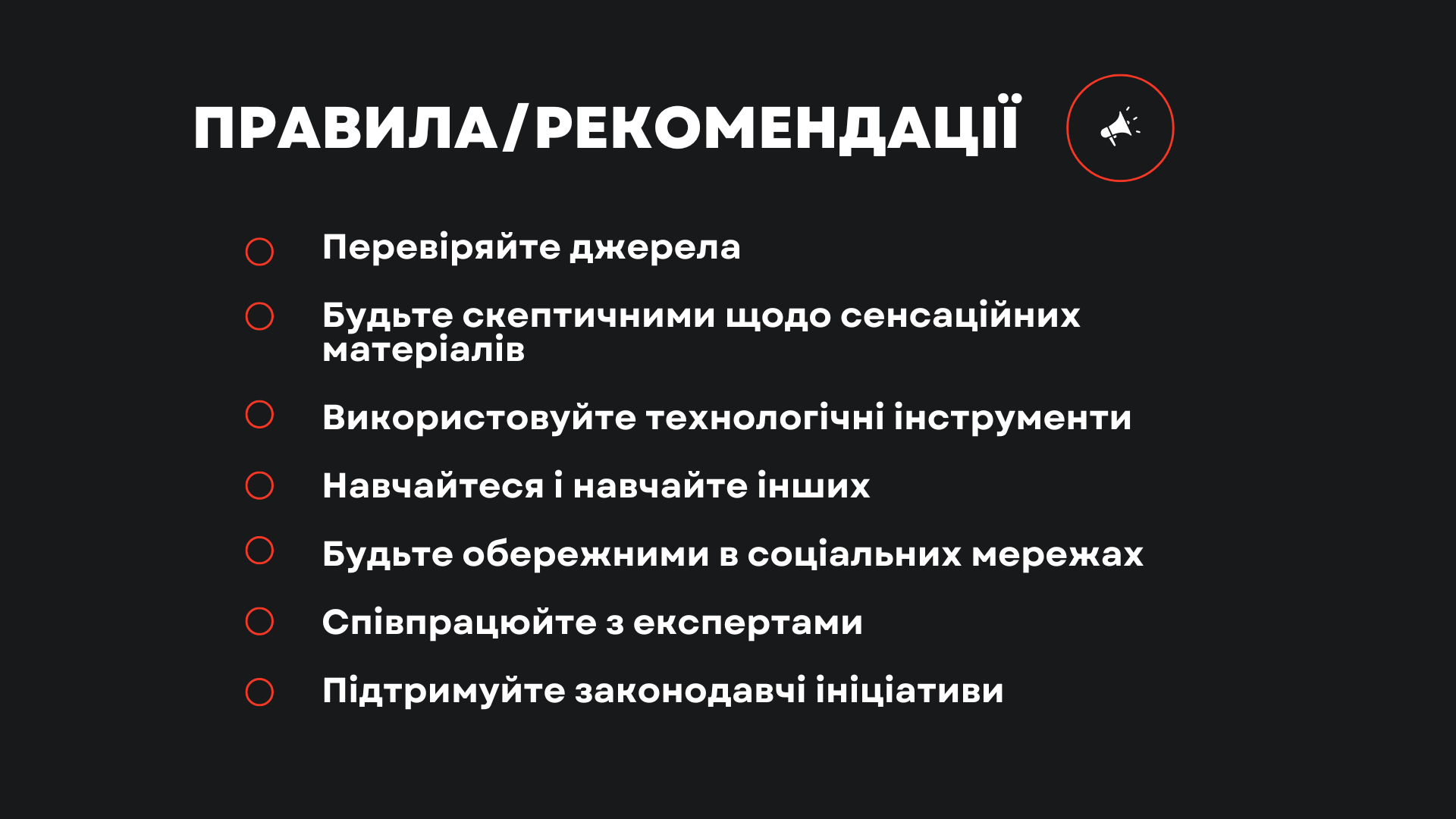

Як суспільство може захиститися від таких небезпек, як дипфейки? Які кроки можуть бути вжиті?

В умовах розвитку технологій дипфейків, важливо, щоб суспільство розвивало медіаграмотність. Люди повинні вміти критично оцінювати інформацію, перевіряти джерела, звертати увагу на деталі і не довіряти сліпо всьому, що бачать або чують в інтернеті. Медіаграмотність стає ключовою навичкою у сучасному світі, де маніпуляції та дезінформація поширюються дуже швидко.

Нагадаємо, в проєкті «Відсіч дезінформації» Наталя Соколенко разом із експертками та експертами допоможуть розібратися в ключових аспектах медіаграмотності та стати більш обізнаними користувачами інформації. Бо в сучасному світі інформаційні потоки змінюють наше життя щосекунди. Фейкові новини, дезінформація, маніпуляції та пропаганда заповнюють простір, тому важливо навчитися критично мислити та відрізняти правду від брехні.